KI-generierte Missbrauchsdarstellungen von Kindern erreichen 2025 Rekordhoch

Im Internet verbreiten sich laut einer aktuellen Erhebung zunehmend KI-generierte Darstellungen von sexuellem Kindesmissbrauch. Der technologische Fortschritt erleichtert es Pädokriminellen, sogenannte Kinderpornografie zu erstellen, was zu einem alarmierenden Anstieg führt.

Rekordzahlen und Verbreitung

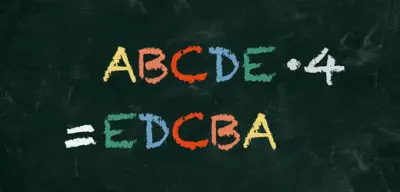

Die britische Stiftung Internet Watch Foundation (IWF) hat neue Zahlen für das Jahr 2025 vorgelegt, die ein Rekordhoch bei KI-generierten Bildern und Videos von sexuellem Kindesmissbrauch zeigen. Insgesamt identifizierten die Analysten mehr als 8000 kriminelle KI-Inhalte, was einem Anstieg von 14 Prozent gegenüber dem Vorjahr entspricht. Diese Inhalte tauchen sowohl in dunklen Ecken des Internets als auch auf bekannten Plattformen auf.

Kerry Smith, CEO der IWF, äußert sich besorgt: "Seit meinem Eintritt im August 2025 bin ich erschüttert über das Ausmaß des Leids, dem Kinder täglich ausgesetzt sind. Nirgendwo wird dies deutlicher als beim rasanten Anstieg von KI-generiertem Material." Zwar machen solche Inhalte noch einen geringen Anteil der Gesamtmeldungen aus, doch die Zahl steigt stetig.

Auswirkungen und Risiken

Laut einem kürzlich veröffentlichten Bericht der IWF schüren KI-generierte Aufnahmen von sexualisierter Gewalt gegen Kinder das pädokriminelle Interesse, normalisieren extreme Gewalt und erhöhen das Risiko von Kontaktstraftaten. Vorwiegend sind Mädchen betroffen – in 97 Prozent der analysierten KI-Inhalte sind sie zu sehen.

Der Bericht mit dem Titel "Leiden ohne Grenzen: KI-Material über sexuellen Kindesmissbrauch aus der Sicht unserer Analysten" schildert Online-Unterhaltungen zwischen Pädokriminellen, die sich anstacheln, immer lebensechtere und extremere Szenen mithilfe von KI zu generieren. Täter tauschen sich etwa darüber aus, wie sie mit versteckten Kameras Aufnahmen echter Kinder erhalten und diese dann in Missbrauchsinhalte umwandeln können.

Technologische Entwicklungen und Herausforderungen

Der schnelle Fortschritt der KI-Tools führt dazu, dass immer weniger technisches Fachwissen für das Generieren solcher Inhalte erforderlich ist, was die Anwendung vereinfacht und niedrigschwellig macht. Zudem können KI-Modelle mit Missbrauchsbildern trainiert werden, wodurch Überlebende von sexuellem Kindesmissbrauch erneut zu Opfern gemacht werden.

Ingo Fock von der Organisation "Gegen Missbrauch e.V." warnt: "Generative KI verleiht Tätern eine große Kontrolle über die Menschen, deren Bilder sie manipulieren können." Fock, der selbst im Kindesalter missbraucht wurde, betont, dass die ständige Verfügbarkeit solcher Aufnahmen im Netz für Betroffene eine nie endende Belastung darstellt.

Rechtliche und gesellschaftliche Reaktionen

Oberstaatsanwalt Markus Hartmann von der Zentral- und Ansprechstelle Cybercrime in Köln (ZAC NRW) äußert Besorgnis, dass künstliche Intelligenz zu einer weiteren Radikalisierung und Enthemmung führen könnte. "Wenn man mit KI individualisiertes Material generieren kann, könnte das eine ohnehin schon laufende Eskalation befeuern", so Hartmann. Seine Behörde hat in der Vergangenheit große Missbrauchsnetzwerke im Netz zerschlagen.

Das Thema beschäftigt Experten und Betroffenenorganisationen seit Jahren, und die aktuellen Zahlen unterstreichen die Dringlichkeit, Maßnahmen gegen die Verbreitung von KI-generiertem Missbrauchsmaterial zu verstärken.