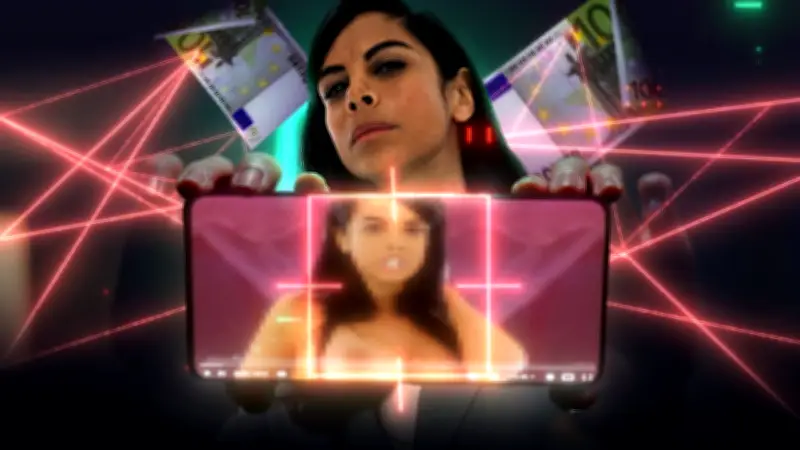

Opfer fast machtlos: Kein klares Strafgesetz gegen Deepfake-Pornos

Über 270.000-mal – so oft wurde einer der Deepfake-Pornos, die angeblich Collien Fernandes zeigen, bereits abgerufen. Der Fall der Schauspielerin sorgt für großes Aufsehen: Ihr Ex-Mann Christian Ulmen soll laut ihren Vorwürfen Fake-Profile erstellt und mit künstlicher Intelligenz manipulierte Pornobilder von ihr verbreitet haben. Fernandes spricht von „digitaler Vergewaltigung“ – ein drastischer Begriff, der deutlich macht, wie schwerwiegend die Vorwürfe für sie sind.

Technik macht es möglich – und das Problem wächst rasant

Die Technologie ist längst verfügbar. Mit künstlicher Intelligenz lassen sich aus wenigen Fotos täuschend echte Videos erstellen. Gesichter werden in Pornos montiert, Stimmen imitiert, komplette Szenen erfunden. Was früher nach Science-Fiction klang, ist heute für viele Täter nur ein paar Klicks entfernt. Für die Betroffenen fühlt sich das oft wie ein echter Übergriff an – Experten betonen deshalb, dass digitale Gewalt ähnlich wirken kann wie reale Gewalt.

Und tatsächlich ist das Problem größer, als viele denken: Deepfake-Pornos nehmen rasant zu – allein von 2019 bis 2023 um 550 Prozent. Laut Studien sind rund 99 Prozent der Betroffenen Frauen. Die Zahlen zeigen eine alarmierende Entwicklung, die dringend politisches Handeln erfordert.

Das Gesetz kommt nicht hinterher

Bis heute gibt es in Deutschland kein klares Strafgesetz gegen Deepfake-Pornos. Wer solche Inhalte erstellt oder verbreitet, bewegt sich oft in einer rechtlichen Grauzone. Zwar können einzelne Vorschriften greifen – etwa wegen Beleidigung oder Verletzung des Rechts am eigenen Bild –, doch die Strafen sind meist milde, und die Hürden für Ermittlungen sind hoch.

Ein großes Problem für Betroffene: Ohne klaren Straftatbestand können Gerichte oft nicht hart durchgreifen. Auch Ermittlungen sind schwieriger. Experten sagen deshalb offen: Das Strafrecht hinkt der technischen Entwicklung hinterher. Strafverteidiger und Fachleute warnen schon länger, dass die bisherigen Gesetze vorwiegend auf andere Fälle zugeschnitten sind – etwa auf Kinderpornografie oder klassische Persönlichkeitsrechtsverletzungen. Für moderne Deepfakes, vor allem im sexuellen Bereich, passen sie oft nicht richtig.

Hinzu kommt: Deepfakes lassen sich schnell und anonym verbreiten – und sind kaum wieder vollständig aus dem Netz zu entfernen. Die bittere Realität: Was sich für Betroffene wie ein massiver Übergriff anfühlt, ist juristisch oft nur schwer zu greifen.

Justizministerin will Blitz-Gesetz

Jetzt will die Politik reagieren. Bundesjustizministerin Stefanie Hubig (SPD) kündigt an, die Lücken im Strafrecht zu schließen. Künftig sollen Täter schneller verfolgt werden können – etwa durch frühere Hausdurchsuchungen schon bei starkem Verdacht. Auch mehr Personal für Staatsanwaltschaften ist geplant.

Das Ziel: Täter sollen sich nicht mehr sicher fühlen. Klar ist aber auch: Noch ist das neue Gesetz nicht beschlossen. Bis dahin bleibt die Lage für Betroffene schwierig. Und genau deshalb wächst der Druck auf die Politik, endlich nachzuschärfen und den Opfern von Deepfake-Pornos wirksamen rechtlichen Schutz zu bieten.