Regional

Freibadsaison startet mit über 25.000 Gästen in Berlin

Bei bis zu 30 Grad zog es Tausende in Berlins Freibäder. Spitzenreiter war das Sommerbad Kreuzberg. Weitere Bäder öffnen im Mai.

Sport

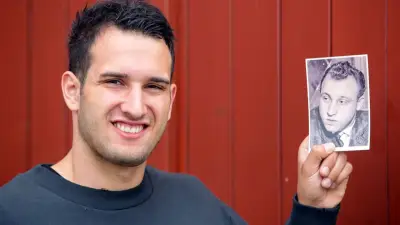

Letztes Seeler-Kapitel beim HSV endet: Öztunali verabschiedet sich

Levin Öztunali, Enkel von HSV-Legende Uwe Seeler, bestreitet am 16. Mai sein letztes Spiel für die U21 des HSV. Nach zwei Jahren und nur 24 Profi-Einsätzen endet die Ära.

Politik

Rangnicks emotionale Rückkehr: RB Leipzig ehrt Aufstiegshelden

Ralf Rangnick kehrt am Samstag nach Leipzig zurück, um mit RB Leipzig den zehnten Jahrestag des Bundesliga-Aufstiegs zu feiern. Zwölf Ex-Spieler sind dabei.

Wirtschaft

Nächstes Audi-Drama: Hülkenberg erneut ohne Punkte in Miami

Nico Hülkenberg erlebt beim Großen Preis von Miami das nächste Audi-Drama: Nach technischen Problemen und einem Ausfall bleibt der Deutsche erneut punktlos.

Kultur

Umwelt

Preisschock auf Polenmarkt: Zigaretten teurer

Ab März steigen die Zigarettenpreise auf dem Grenzmarkt in Swinemünde drastisch. Händler klagen über sinkende Kundenzahlen, Urlauber rechnen nach.

Warum Mücken nicht ausgerottet werden können

Jedes Jahr kehren Mücken zurück. Warum eine vollständige Ausrottung der Plagegeister nicht möglich ist und welche Rolle sie im Ökosystem spielen.

Pflanzenbörse in Krembz: Kräuter kaufen, tauschen

Zum dritten Mal veranstaltete ein Freundeskreis aus der Region Stöllnitz eine Pflanzenbörse in Krembz. Dabei konnten Kräuter und Stauden nicht nur gekauft, sondern auch getauscht und verschenkt werden.

Umweltminister tagen zu Wasser, Klima und Co in Leipzig

Die Umweltminister von Bund und Ländern kommen zur Frühjahrstagung in Leipzig zusammen. Themen sind unter anderem Meeresschutz, Einweg-E-Zigaretten, Gipsrecycling und Wasserversorgung.

Regenbogen in Tibet: Märchen oder Realität?

Ein atemberaubender Regenbogen in Tibet wirkt fast unwirklich und begeistert im Netz. Experten erklären das Phänomen als seltenes Naturereignis.

Gesundheit

Updates erhalten

Abonnieren Sie unseren Newsletter, um die neuesten Nachrichten direkt in Ihrem Postfach zu erhalten!

Wir versenden niemals Spam